Dacă în luna august ai petrecut mult timp pe TikTok, teoretic puteai să afli că în țara noastră urmează să vină 800 de … spartani! Da, falsurile cu sirieni și gay au ieșit din modă. Ba mai mult, „cunoscuta bunicuță cu hipopotam” a fost reținută de tocmai trei polițiști în timp ce protesta pentru eliberarea Evgheniei Guțul. Au fost și alte „noutăți” emoționante, văzute de sute de mii de oameni și generate total sau parțial de inteligența artificială. În continuare, îți vom arăta și explica cum AI-ul a devenit un instrument folosit pe larg de „mașina de propagandă” a Federației Ruse, prin intermediul unei analize publicate pe Mediacritca.

Acum un an, aproximativ 34 de milioane de fotografii erau generate zilnic cu ajutorul inteligenței artificiale. Volumul de conținut creat cu AI crește rapid și constant, devenind parte a războaielor informaționale și hibride, iar Republica Moldova nu face nicidecum excepție.

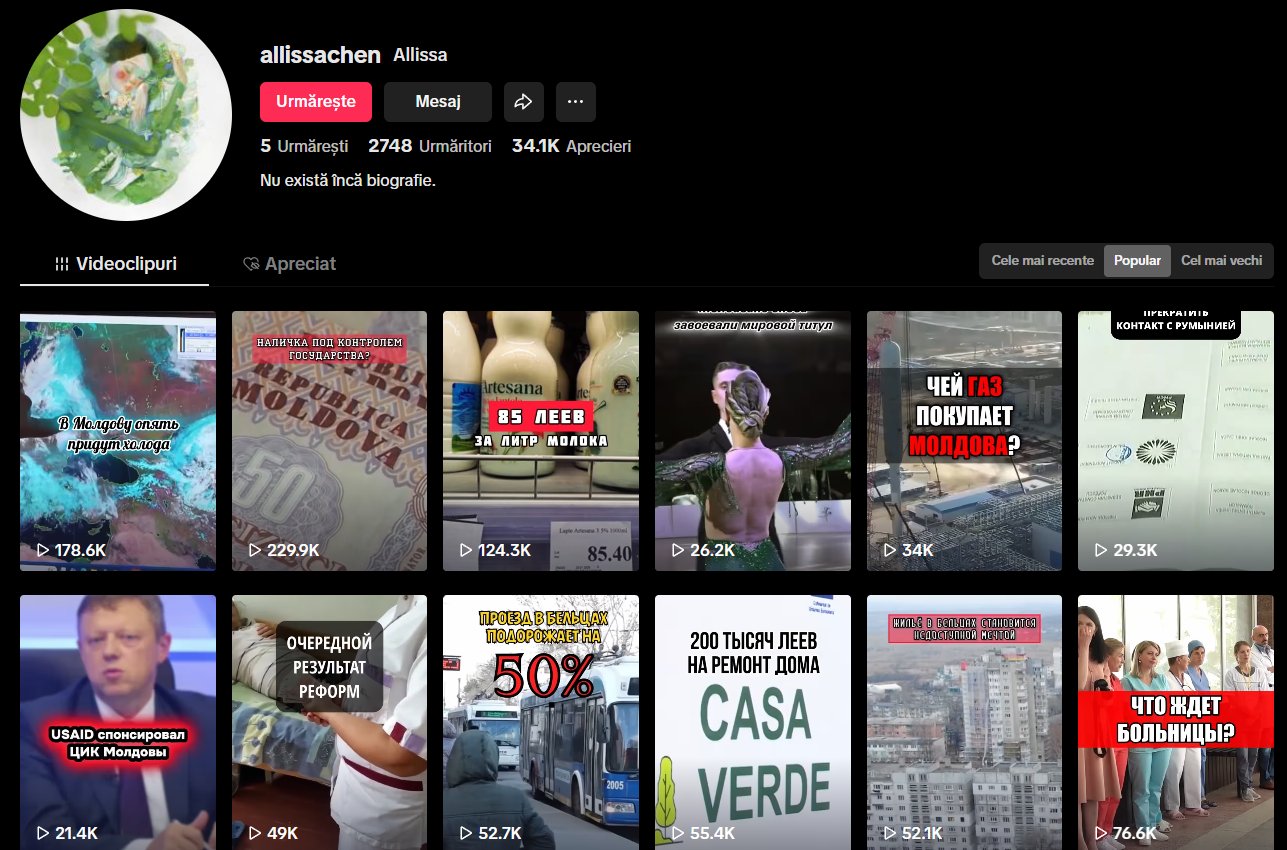

TikTok-ul moldovenesc este „invadat” zilnic de videoclipuri manipulative sau false, create parțial sau în totalitate cu instrumente de inteligență artificială. Subiectele lor coincid, în mare parte, cu narațiunile de dezinformare promovate în aceeași perioadă de politicieni, influenceri și conturi anonime asociate cu Federația Rusă sau Ilan Șor.

În lunile precedente, folosind hashtagurile din descriere, am identificat zeci de videoclipuri false, generate parțial sau în totalitate cu AI, care promovau narațiuni „clasice” precum „atragerea Moldovei în război” sau „implicarea Franței în alegerile din Republica Moldova”. Acum însă, „mașinăria de propagandă” folosește hashtaguri comune, precum #moldova sau #chisinau, infiltrându-se astfel printre sute de videoclipuri publicate zilnic și de utilizatori reali.

Vocile pe care, cel mai probabil, le-ai mai auzit undeva

Cel mai des, narațiunile manipulative sunt răspândite prin clipuri video în stil fast news (știri scurte), cu voci generate de AI. În unele cazuri, sunetul redat imită cu acuratețe vocea umană, încât internauții îl pot confunda cu ușurință cu cea unei persoane adevărate. În alte situații, prezența inteligenței artificiale este trădată de tonalitatea robotică, pronunția greșită sau pauzele nefirești. În oricare dintre cazuri, videoclipurile își ating scopul, având impact și reușind să transmită mesajele intenționate către public.

Un exemplu ține de un fals despre care a Mediacritica a anunțat și anterior – că în Republica Moldova vor veni 800 de militari NATO înainte de alegeri.

Într-un video „vociferat” cu AI, această informație inventată este prezentată drept o imixtiune în alegerile parlamentare din 28 septembrie. Curios este că AI-ul le-a jucat festa autorilor și, în loc de militari, acesta anunță că în Republica Moldova vor veni „800 de spartani”. Acest fals alimentează, de fapt, câteva dintre narațiunile promovate constant de propaganda rusă în ultimele luni: înarmarea Moldovei și atragerea în război, controlul din exterior și intenția de falsificare a alegerilor.

Pagina care a publicat acest videoclip, dar și multe alte postări generate cu ajutorul AI produce conținut încă din perioada alegerilor prezidențiale din 2024 și are clipuri video care depășesc 100.000 de vizionări.

O altă pagină care folosește conținut generat cu AI a distribuit un videoclip despre „împărțirea țării cu ajutorul religiei”. Mesajul este narat de o voce falsă, plasată peste imagini preluate din altă sursă. Cu alte cuvinte, imaginea pare reală, dar vocea este generată artificial.

Cel mai probabil, s-a recurs la această abordare pentru a crea impresia că mesajul aparține unei persoane reale.

Aceeași pagina publică în special materiale în favoarea Victoriei Furtună. Într-un alt videoclip, de exemplu, este prezentată o deplasare electorală a politicienei. De această dată, atât vocea, cât și figura persoanei care „vorbește” în colțul ecranului au fost generate cu AI.

„Bunicuțele” care nu există

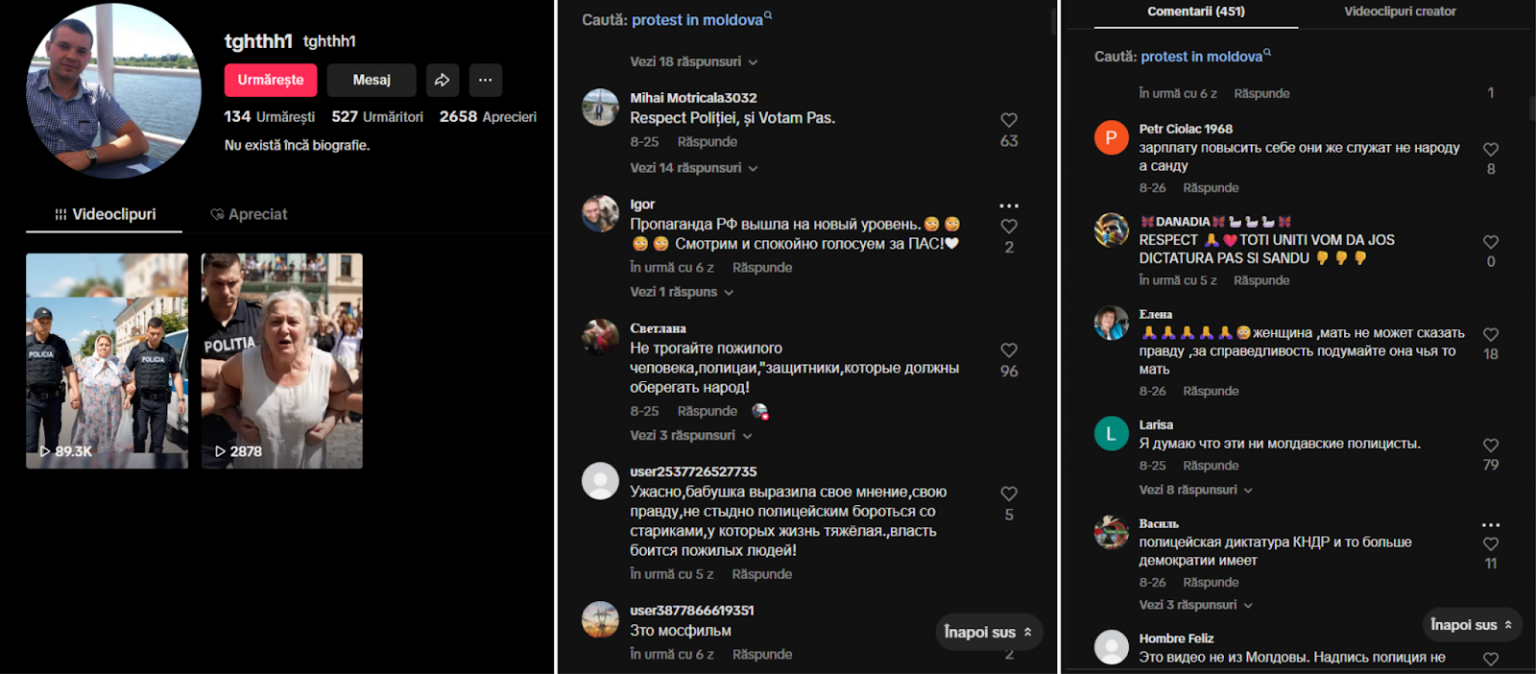

În anul 2025, fiecare dintre noi poate genera aproape gratuit un videoclip realist cu o „bunicuță care are ca animal de companie un hipopotam”. Același lucru îl face și propaganda, doar că în loc de hipopotam apare o „bunicuță încătușată de polițiști, pentru că ar fi ieșit să o apere pe Evghenia Guțul”.

Mai jos am amplasat trei imagini. Ghici care sunt reale și care au fost generate cu AI.

În august, „mașinăria de propagandă” s-a concentrat în special pe condamnarea bașcanei Evghenia Guțul. Subiectul a fost promovat mult mai intens decât altele, atât de bloggeri afiliați lui Ilan Șor, cât și prin prisma videoclipurilor generate cu inteligență artificială.

Imaginile prezentate mai sus au fost create cu AI și fac parte dintr-o mulțime de materiale video false publicate de propagandă în favoarea bașcanei. Postările au practic același subiect: o femeie în vârstă strigă „libertate pentru Guțul!” și se întreabă: „De ce sunt reținută?”.

Pe lângă încercarea de a induce falsa iluzie a unei susțineri populare a bașcanei, se dorește a fi transmis mesajul că poliția își depășește atribuțiile de serviciu și că oamenii din Republica Moldova sunt reținuți sau persecutați pe criterii politice.

Unul dintre aceste videoclipuri, evident generat cu AI, a strâns aproape 90.000 de vizionări. În comentarii, mai mulți utilizatori reali fie condamnă, fie susțin gestul „poliției” prezentat în video.

Mai nou, pe lângă Ilan Șor, „bunicuțele” au început să se pronunțe activ și în favoarea lui Vladimir Plahotniuc, reținut în Grecia. Într-un video generat cu AI, protagonista susține că s-ar bucura de revenirea fostului lider PD în politică, fiindcă s-a „săturat de gălbeneața aceasta de PAS”.

Într-un alt videoclip, cu peste 200.000 de vizionări, trei persoane în vârstă cântă și îl cheamă acasă pe Plahotniuc pentru „a o da jos pe Maia”.

Batman de la PSRM?

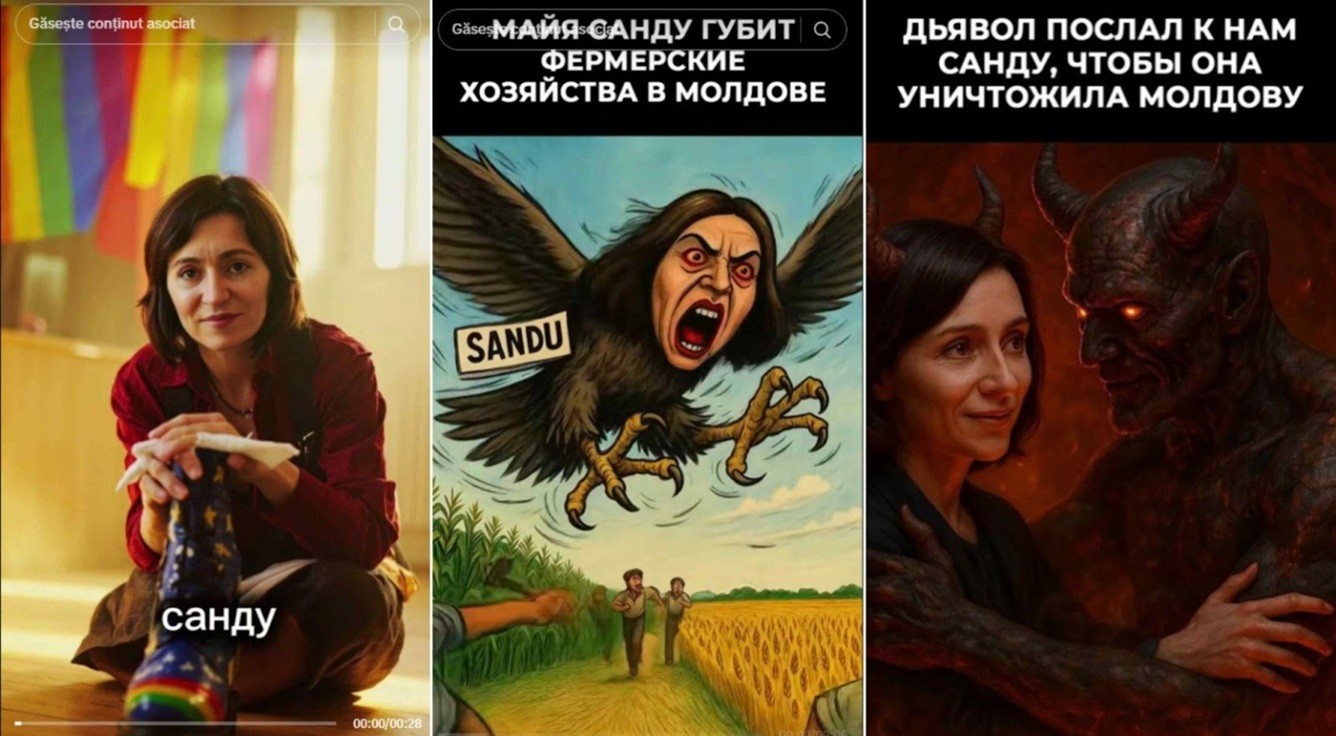

Inteligența artificială nu este folosită pe TikTok doar pentru a crea iluzia unor persoane și evenimente reale. În unele cazuri, e un instrument de manipulare crasă, cu ajutorul căruia sunt promovate narațiuni false prin imagini generate sută la sută, evident ireale.

De exemplu, într-un clip video în care se afirmă că „Maia Sandu ar controla justiția”, imaginea Președintei este plasată alături de simbolurile comunității LGBTQ+, apelându-se la homofobie pentru a o demoniza.

În alte cazuri, șefa statului figurează pe conturi care distribuie conținut în favoarea lui Ilan Șor, în ipostaze extreme: alături de un demon sau sub forma unei creaturi mitologice. Aceste imagini, însoțite de texte manipulative, sugerează că Maia Sandu ar distruge Moldova. Grupul lor țintă sunt vorbitorii de limbă rusă.

Am identificat și videoclipuri în care partidul de guvernare este prezentat drept corupt, prin imagini menite să stârnească emoții. Persoane îmbrăcate în culorile și cu simbolurile Partidului Acțiune și Solidaritate apar furând bani de la o mamă cu trei copii sau de la bătrâni, pentru a transmite ideea că guvernarea îi jefuiește pe cei mai vulnerabili.

Panica artificială din comentarii

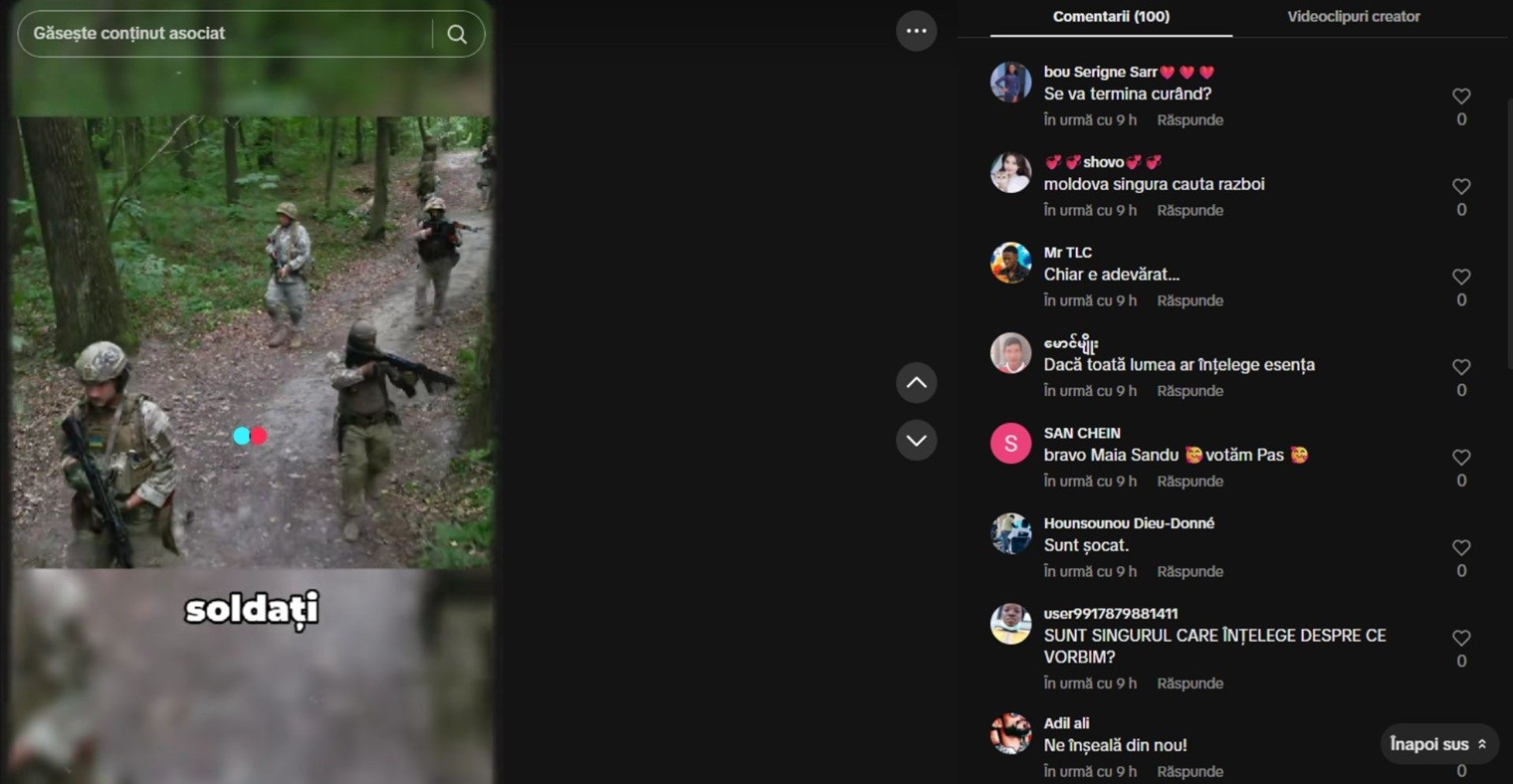

Alături de elementele vizuale și audio, secțiunea de comentarii funcționează adesea ca un instrument suplimentar de manipulare a publicului. De exemplu, la un videoclip fals despre „implicarea Moldovei în războiul din Ucraina” apar comentarii în limba română, scrise de utilizatori din Myanmar, Bangladesh sau Benin. Unul spune că „lumea nu înțelege esența”, altul afirmă că „Moldova singură caută război”, iar al treilea profil susține că situația din țara noastră „șochează”.

Comentariile false sunt utilizate în principal pentru a amplifica vizibilitatea și credibilitatea artificială a unui conținut. Prin crearea unei aparente popularități, algoritmii platformei favorizează distribuirea materialului, ceea ce explică de ce un videoclip analizat de noi a depășit pragul de 100.000 de vizualizări. În paralel, aceste comentarii activează efectul de conformism social («efectul de turmă»), prin care utilizatorii tind să preia opiniile majorității aparente și rareori investighează identitatea reală a celor care le formulează.

Prin voci artificiale credibile, imagini fabricate și comentarii false, care induc o falsă legitimitate socială, aceste materiale distorsionează percepția publică asupra realității și erodează încrederea cetățenilor în procesul electoral, în instituțiile statului și în democrație în general, menționează Mediacritica.